數(shù)據(jù)湖存儲格式Hudi 原理、實(shí)踐與數(shù)據(jù)處理存儲服務(wù)支持

隨著大數(shù)據(jù)技術(shù)的飛速發(fā)展,數(shù)據(jù)湖已成為企業(yè)數(shù)據(jù)架構(gòu)的核心組成部分。它旨在存儲海量的原始數(shù)據(jù),支持多種數(shù)據(jù)類型和處理范式。在數(shù)據(jù)湖的構(gòu)建中,存儲格式的選擇至關(guān)重要,它直接影響到數(shù)據(jù)的查詢效率、更新能力、事務(wù)支持以及存儲成本。Apache Hudi(Hadoop Upserts Deletes and Incrementals)作為一種先進(jìn)的數(shù)據(jù)湖存儲格式,以其對增量數(shù)據(jù)處理、近實(shí)時攝取和高效更新/刪除操作的原生支持,在業(yè)界獲得了廣泛應(yīng)用。本文將深入探討Hudi的核心原理,分享其實(shí)踐經(jīng)驗,并闡述其在數(shù)據(jù)處理與存儲支持服務(wù)中的關(guān)鍵作用。

一、Hudi的核心原理

Hudi的設(shè)計哲學(xué)是解決傳統(tǒng)大數(shù)據(jù)存儲格式(如Parquet、ORC)在支持更新、刪除和增量處理方面的不足。其核心原理圍繞以下幾個方面構(gòu)建:

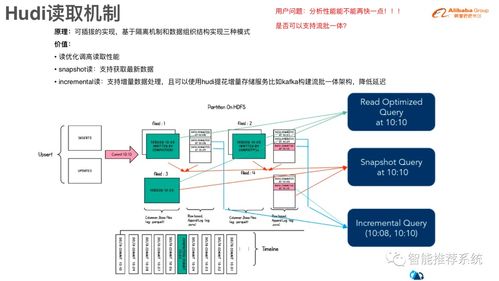

- 表類型與查詢類型:Hudi定義了兩種主要的表類型——Copy-on-Write(COW)和Merge-on-Read(MOR)。

- COW表:在寫入時,通過創(chuàng)建包含更新/刪除記錄的新數(shù)據(jù)文件副本來實(shí)現(xiàn)數(shù)據(jù)修改。查詢時直接讀取最新的數(shù)據(jù)文件,因此讀取性能最佳,但寫入延遲相對較高,適合讀多寫少的場景。

- MOR表:寫入時,更新和刪除操作被記錄到增量日志文件中,而基礎(chǔ)數(shù)據(jù)文件保持不變。查詢時需要合并基礎(chǔ)文件和增量日志來提供最新視圖。這種設(shè)計實(shí)現(xiàn)了低延遲的寫入和高吞吐量的批量讀取,適合寫多讀少的場景。

- 時間線(Timeline):這是Hudi的元數(shù)據(jù)核心,按時間順序記錄了在數(shù)據(jù)集上執(zhí)行的所有操作(如提交、清理、壓縮)。它提供了數(shù)據(jù)集的原子性視圖,并支持時間旅行查詢,允許用戶查詢某個歷史時間點(diǎn)的數(shù)據(jù)快照。

- 索引機(jī)制:Hudi提供了多種索引類型(如布隆過濾器索引、HBase索引、自定義索引),用于在寫入時快速定位一條記錄所在的數(shù)據(jù)文件。這是高效實(shí)現(xiàn)Upsert和Delete操作的關(guān)鍵,避免了為更新少量記錄而全表掃描的成本。

- 文件布局與壓縮:Hudi將數(shù)據(jù)組織成文件組(File Group),每個文件組包含一個基礎(chǔ)數(shù)據(jù)文件和多個增量日志文件(MOR表)。定期的壓縮操作會將增量日志合并到基礎(chǔ)文件中,優(yōu)化存儲和讀取性能。

二、Hudi的實(shí)踐應(yīng)用

在實(shí)踐中,Hudi能夠有效解決諸多數(shù)據(jù)工程挑戰(zhàn):

- 近實(shí)時數(shù)據(jù)攝取:通過流式處理引擎(如Apache Spark Structured Streaming, Apache Flink)可以將Kafka等消息隊列中的數(shù)據(jù)以極低延遲(分鐘級甚至秒級)寫入Hudi表,構(gòu)建近實(shí)時數(shù)據(jù)湖。

- 增量ETL與CDC:Hudi原生支持增量查詢,能夠高效地識別出自上次處理以來發(fā)生變化的數(shù)據(jù)。這極大地簡化了變更數(shù)據(jù)捕獲(CDC)場景下的ETL管道,只需處理增量數(shù)據(jù)而非全量數(shù)據(jù),節(jié)省了大量計算資源。

- 支持更新與刪除:對于需要符合GDPR等數(shù)據(jù)隱私法規(guī),或業(yè)務(wù)本身需要修正歷史數(shù)據(jù)的場景,Hudi提供了對記錄級更新和刪除的操作支持,這是許多傳統(tǒng)數(shù)據(jù)湖格式難以做到的。

- 統(tǒng)一批流存儲:Hudi表可以同時作為批處理和流處理作業(yè)的源與目標(biāo),實(shí)現(xiàn)了存儲層的批流一體,簡化了架構(gòu)。

典型的技術(shù)棧集成包括:使用Apache Spark或Fink進(jìn)行數(shù)據(jù)寫入與處理,使用Presto/Trino、Hive或Spark SQL進(jìn)行交互式查詢,并利用Hudi的元數(shù)據(jù)同步功能與Hive Metastore集成,使得現(xiàn)有工具可以無縫訪問Hudi表。

三、作為數(shù)據(jù)處理和存儲支持服務(wù)的關(guān)鍵組件

在企業(yè)級數(shù)據(jù)平臺中,Hudi扮演著至關(guān)重要的數(shù)據(jù)處理與存儲支持服務(wù)角色:

- 提供高效、彈性的存儲服務(wù):通過COW和MOR兩種表類型,Hudi服務(wù)可以根據(jù)不同的SLA(服務(wù)水平協(xié)議)要求(讀取延遲 vs 寫入延遲)提供差異化的存儲方案。其自動的文件管理(清理、歸檔、壓縮)功能降低了運(yùn)維成本。

- 賦能數(shù)據(jù)管道服務(wù):作為數(shù)據(jù)管道的關(guān)鍵一環(huán),Hudi服務(wù)提供了可靠的、具有事務(wù)保證的數(shù)據(jù)接收端點(diǎn)。其增量處理能力使得下游的數(shù)據(jù)轉(zhuǎn)換、建模和聚合作業(yè)能夠以增量方式運(yùn)行,構(gòu)建高效、低延遲的數(shù)據(jù)流水線。

- 支持?jǐn)?shù)據(jù)治理與質(zhì)量:時間旅行功能為數(shù)據(jù)審計、回滾和重復(fù)計算提供了基礎(chǔ)。更新/刪除能力直接支持了數(shù)據(jù)糾錯和合規(guī)性要求,提升了數(shù)據(jù)湖的數(shù)據(jù)質(zhì)量和可信度。

- 優(yōu)化計算資源與成本:通過增量處理模式,大幅減少了不必要的數(shù)據(jù)掃描和計算,直接降低了計算集群的資源消耗和云上成本。高效的列式存儲格式(底層通常為Parquet)也優(yōu)化了存儲成本。

結(jié)論

Apache Hudi通過創(chuàng)新的存儲格式設(shè)計,有效彌合了傳統(tǒng)數(shù)據(jù)倉庫與數(shù)據(jù)湖之間的能力鴻溝,為大數(shù)據(jù)生態(tài)系統(tǒng)帶來了急需的更新、刪除和增量處理能力。理解和掌握Hudi的原理,并成功將其集成到數(shù)據(jù)架構(gòu)的實(shí)踐中,能夠幫助企業(yè)構(gòu)建更實(shí)時、更高效、更易維護(hù)的數(shù)據(jù)湖,從而為上層的數(shù)據(jù)分析、機(jī)器學(xué)習(xí)和實(shí)時應(yīng)用提供強(qiáng)大的數(shù)據(jù)存儲與處理支持服務(wù)。隨著數(shù)據(jù)實(shí)時性需求的日益增長,Hudi及其代表的技術(shù)方向?qū)⒗^續(xù)在數(shù)據(jù)湖的演進(jìn)中扮演核心角色。

如若轉(zhuǎn)載,請注明出處:http://m.harmansecurity.cn/product/51.html

更新時間:2026-04-06 05:27:36